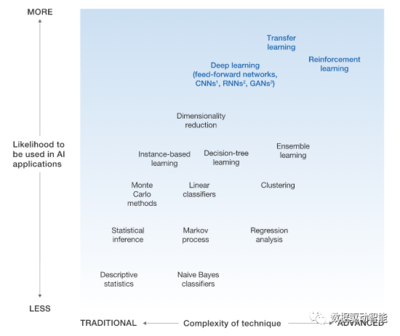

随着人工智能的迅猛发展,深度学习作为核心技术之一,已在图像识别、自然语言处理等领域取得显著成果。其广泛应用仍面临若干关键问题。同时,网络技术的研究为这些问题的解决提供了重要支撑。本文将结合网络技术探讨深度学习的四个核心问题。

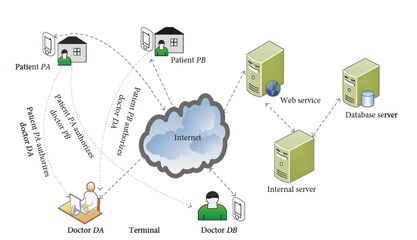

数据依赖与质量问题是深度学习的首要挑战。深度学习模型通常需要大量标注数据进行训练,而数据的获取与标注成本高昂。数据质量直接影响模型性能,噪声数据或不平衡数据集可能导致模型偏差。在网络技术研究中,分布式数据采集与边缘计算技术能够帮助高效收集与预处理数据,而联邦学习等隐私保护技术则可在不集中数据的前提下进行模型训练,缓解数据孤岛问题。

模型可解释性不足制约了深度学习的可信应用。许多深度学习模型如黑盒一般,决策过程难以理解,这在医疗、金融等高风险领域尤为关键。网络技术的研究通过可视化工具和在线分析平台,促进了模型内部机制的探索。例如,基于云端的交互式系统允许研究人员实时监控和解释模型行为,结合图神经网络(GNN)等技术,提升了对复杂数据关系的理解。

第三,计算资源需求巨大是深度学习的另一瓶颈。训练深度模型需要高性能硬件,如GPU集群,导致成本高昂且能耗大。网络技术在此方面发挥了关键作用,通过云计算和分布式计算框架(如TensorFlow和PyTorch的分布式版本),实现了资源的弹性调度与共享。软件定义网络(SDN)和5G技术进一步优化了数据传输效率,支持大规模模型在边缘设备与云端协同训练,降低了延迟与带宽压力。

泛化能力与鲁棒性问题限制了深度学习的实际部署。模型在训练数据上表现优异,但面对未知环境或对抗性攻击时可能失效。网络技术的研究通过构建模拟环境和实时测试平台,帮助评估模型鲁棒性。例如,利用虚拟网络和仿真工具,可以生成多样化的测试场景,而自适应网络协议则能确保模型在动态网络条件下保持稳定性能。区块链技术被探索用于记录模型版本与数据溯源,增强系统的可靠性与安全性。

深度学习的四个问题——数据依赖、可解释性、资源需求和泛化能力——在本质上是相互关联的,而网络技术的研究为解决这些问题提供了创新途径。未来,随着边缘计算、6G网络和量子计算等技术的发展,深度学习有望在更广泛的领域实现突破,推动人工智能的可持续发展。研究者应加强跨学科合作,将网络技术与深度学习深度融合,以应对日益复杂的应用需求。